Artikelrecherche automatisieren: 90% Kosten sparen

Stellen Sie sich vor: Ein ganzes Schwerlastregal voll mit Ersatzteilen, die nur darauf warten, in den Onlineshop zu kommen. Aber für jeden einzelnen Artikel braucht ein Mitarbeiter 15 Minuten manuelle Recherche. Der Geschäftsführer sagt: “Bei dem Tempo brauchen wir zwei Jahre, bis alles online ist.”

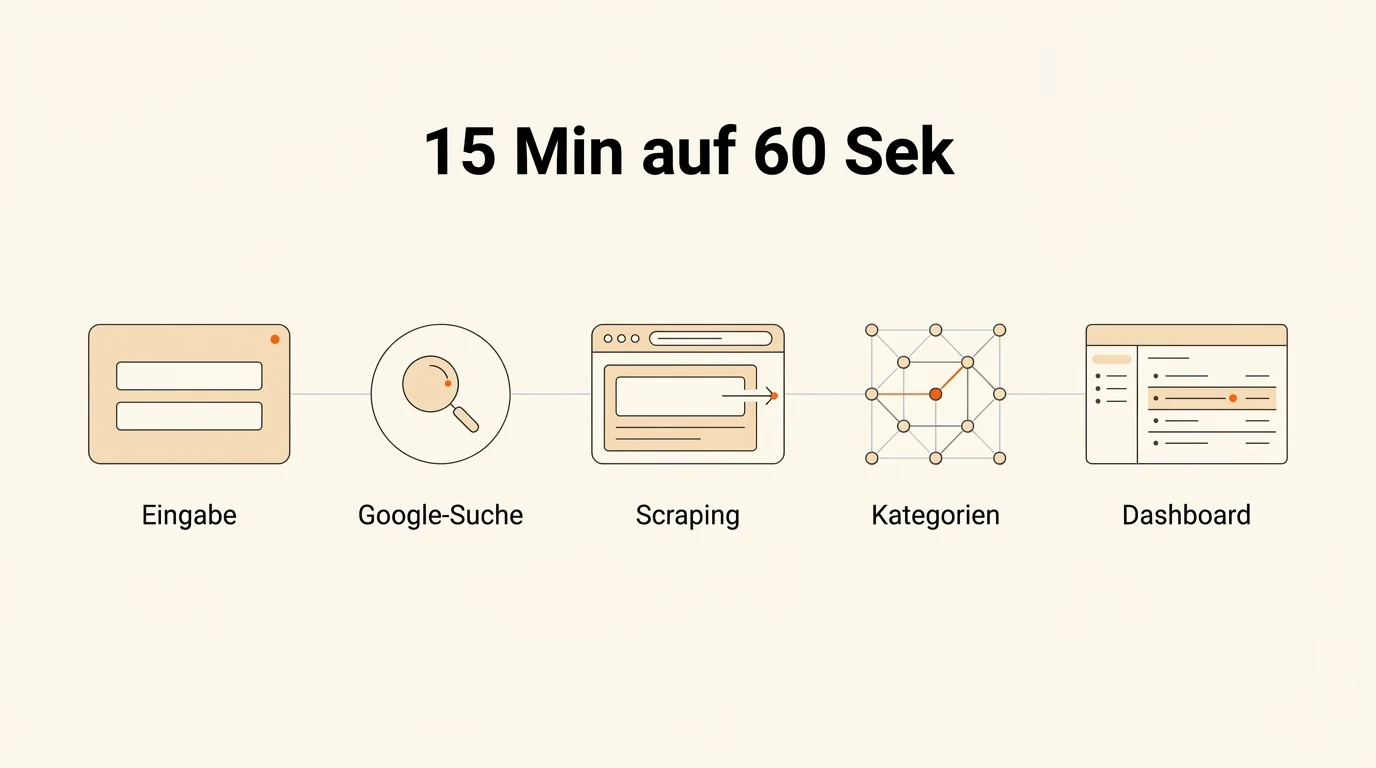

Genau das war die Ausgangssituation bei meinem Kunden im Ersatzteilhandel. In diesem Artikel zeige ich Ihnen, wie ich die Artikelrecherche von 15 Minuten auf unter 60 Sekunden automatisiert habe. Mit konkreten Zahlen, dem Tech-Stack und den Learnings, die auch für Ihr Unternehmen relevant sind.

Die Ausgangssituation: 15 Minuten pro Artikel

Mein Kunde betreibt einen Onlineshop für Maschinenersatzteile. Das Geschäftsmodell: Maschinen aus Auflösungen und Versteigerungen kaufen, zerlegen, die brauchbaren Ersatzteile über den eigenen Shop verkaufen. Ein solides Geschäft mit wachsender Nachfrage.

Das Problem lag nicht bei der Ware. Es lagen genügend Teile im Lager. Das Problem lag bei der Artikelerfassung.

Der manuelle Prozess

Für jeden Artikel lief der Prozess so ab:

- Artikel aus der Gitterbox holen. Die Ersatzteile sind nach dem Ausbau in Gitterboxen verpackt und im Schwerlastregal eingelagert.

- Hersteller und Artikelnummer ablesen. Meist eingraviert oder aufgeklebt. Mehr Informationen hat man zu Beginn nicht.

- Online recherchieren. Herstellerseiten, Konkurrenz-Shops, Marktplätze durchsuchen, um technische Spezifikationen zu finden.

- Produktkategorie bestimmen. Der Onlineshop hat über 300 Kategorien. Jede Kategorie hat eigene Pflichtattribute. Ist das ein Sensor? Ein Ventil? Ein Antrieb? Ohne Fachwissen ist das schwierig.

- Daten zusammenstellen und im Shop anlegen. Technische Daten, Beschreibung, Foto.

Das Ergebnis: 15 Minuten pro Artikel. Bei Mindestlohn (13,90 EUR/Stunde) sind das 3,48 EUR reine Recherchekosten pro Artikel.

Warum das zum Problem wurde

Die Mitarbeiter, die diese Arbeit erledigen, sind Minijobber. Sie bringen keine technische Expertise mit. Sie wissen oft nicht, in welche der 300+ Kategorien ein Artikel gehört. Und selbst wenn die Kategorie stimmt: Jede Kategorie hat andere Pflichtattribute. Ein Sensor braucht Spannungsangaben, ein Hydraulikventil braucht Druckwerte.

Das führt zu zwei Problemen: Die Arbeit dauert lange und die Datenqualität schwankt.

Ein Mitarbeiter schafft 4 Artikel pro Stunde. Bei einem 8-Stunden-Tag sind das 32 Artikel. Das Lager hat Tausende Artikel, die auf Erfassung warten. Jeder Tag, an dem ein Artikel offline im Lager liegt, bedeutet: kein Umsatz, aber Lagerkosten und gebundenes Kapital.

Erster Ansatz: KI-Agenten

Mein erster Gedanke: Ich baue einen KI-Agenten, der die komplette Recherche übernimmt. Der Agent bekommt Hersteller und Artikelnummer, sucht selbstständig im Internet, analysiert die Ergebnisse und liefert die strukturierten Produktdaten.

Aufbau der ersten Version

Ich habe ein einfaches Frontend mit Lovable gebaut. Ein Formular: Artikelnummer und Hersteller eingeben, auf “Suchen” klicken. Im Hintergrund lief ein n8n-Workflow mit einem Orchestrator-Agenten.

Der Agent hatte drei Werkzeuge:

- Google-Suche über Data for SEO. Organische Suchabfrage mit Hersteller + Artikelnummer. Die Top-Ergebnisse (ohne eBay, da unzuverlässig) wurden zurückgegeben.

- Webscraping über Firecrawl. Jede gefundene URL wurde gescrapt, um die technischen Daten von den Seiten zu extrahieren.

- Kategoriezuordnung über eine Vektordatenbank. In Supabase lagen alle 300+ Kategorien mit ihren Pflichtattributen als Embeddings. Über semantische Suche wurde die passende Kategorie ermittelt.

Ein zweiter Agent hat die gesammelten Daten dann in ein strukturiertes Format gebracht und ans Dashboard zurückgegeben.

Warum KI-Agenten nicht die richtige Lösung waren

Die erste Version funktionierte. Aber sie hatte ein entscheidendes Problem: Performance.

Der Agent hat nachgedacht, geplant, Tool-Calls gemacht, Ergebnisse analysiert, weiter geplant. Das dauerte 2 bis 3 Minuten pro Artikel. Für den Nutzer bedeutete das: Artikelnummer eingeben, warten, auf das Dashboard schauen, weiter warten.

Noch schlimmer: Wenn ein Tool-Call fehlschlug oder die Syntax nicht passte, kam nach 2 bis 3 Minuten Wartezeit nur eine kryptische Fehlermeldung. Der Mitarbeiter hatte keine Möglichkeit zu erkennen, ob gerade gearbeitet wird oder ob etwas schiefgelaufen ist.

Das Feedback meines Kunden war klar: “Funktioniert oft gut, aber auch oft nicht. Und es muss schneller gehen. Unter einer Minute.”

Die bessere Lösung: Automatisierung statt Agenten

Mein Learning: Der KI-Agent war für diese Aufgabe zu viel des Guten. Die Planung, die ein Agent betreibt (“Welches Tool rufe ich als Nächstes auf? Was mache ich mit dem Ergebnis?”), war hier unnötig. Der Ablauf ist bei jedem Artikel identisch: Suchen, Scrapen, Kategorisieren, Zusammenfassen.

Ich habe die Agenten-Logik durch eine feste Automatisierung ersetzt.

Der neue Workflow

- Eingabe im Frontend. Artikelnummer + Hersteller im Lovable-Dashboard eingeben, “Suche starten” klicken.

- Direkte Google-Suche. Kein Agent entscheidet, ob gesucht werden soll. Der Workflow ruft sofort Data for SEO auf. Die Top-Suchergebnisse kommen zurück (eBay wird automatisch exkludiert).

- Prüfung auf leere Ergebnisse. Falls nichts gefunden wird (alter Artikel, keine Online-Präsenz), wird das sofort im Dashboard angezeigt. Kein Warten auf einen Timeout.

- Paralleles Scraping. Firecrawl scrapt die gefundenen URLs. Die Rohtexte werden bereinigt.

- Parallele Kategoriezuordnung. Gleichzeitig läuft die semantische Suche in der Supabase-Vektordatenbank. Aus einer Zusammenfassung der Suchergebnisse wird ein Embedding erzeugt und gegen die 300+ Kategorien mit ihren Pflichtattributen abgeglichen.

- KI-Analyse. Die gescrapten Texte und die Pflichtattribute gehen an ein KI-Modell. Ich verwende GPT-4.1 Nano: schnell, günstig und für diese Aufgabe völlig ausreichend. Das Modell extrahiert die technischen Daten, ordnet sie den Pflichtattributen zu und kennzeichnet optionale Informationen.

- Ausgabe im Dashboard. Die strukturierten Produktdaten erscheinen im Lovable-Frontend. Inklusive Quellenangaben, damit der Mitarbeiter die Daten prüfen kann.

Warum das besser funktioniert

Der entscheidende Unterschied: Kein Agent plant und entscheidet. Der Workflow ist fest definiert. Jeder Schritt folgt direkt auf den vorherigen. Parallele Ausführung wo möglich (Scraping und Kategorisierung laufen gleichzeitig).

Das Ergebnis: Unter 60 Sekunden statt 2 bis 3 Minuten. Und praktisch keine Fehler mehr, weil es keine dynamischen Tool-Calls gibt, die fehlschlagen können.

Die Ergebnisse in Zahlen

| Metrik | Vorher (manuell) | Nachher (automatisiert) |

|---|---|---|

| Zeit pro Artikel | 15 Minuten | unter 1 Minute |

| Artikel pro Stunde | 4 | 60 |

| Kosten pro Artikel | 3,48 EUR | 0,23 EUR |

| Artikel pro Tag (Spitzenwert) | ~30 | 450 |

| Realistisch pro Jahr | 6.700 | 63.000 |

| Jährliche Kosten (gleiche Menge) | 218.000 EUR | 23.000 EUR |

| Ersparnis pro Jahr | ~195.000 EUR |

Die Projektkosten: unter 5.000 EUR. Die Umsetzungsdauer: unter 6 Wochen (inklusive einer Testphase und einer Überarbeitung).

Der Return on Investment: Nach wenigen Tagen im Einsatz waren die Projektkosten wieder drin. Die Mitarbeiter nutzen das Tool bereits im Produktivbetrieb, obwohl es offiziell noch gar nicht final freigegeben ist. Zitat eines Mitarbeiters: “Das Tool ist so viel besser. Ich will nicht mehr ohne arbeiten.”

Dazu kommen Opportunitätskosten, die sich schwerer beziffern lassen: Jeder Artikel, der schneller online ist, kann früher verkauft werden. Jeder Lagerplatz, der früher frei wird, kann für neue Ware genutzt werden.

Learnings: Was ich aus diesem Projekt gelernt habe

1. Performance vor Perfektion

KI-Agenten liefern oft bessere Ergebnisse, weil sie nachdenken und planen. Aber wenn der Mitarbeiter 60 Sekunden auf ein “gut genug”-Ergebnis wartet statt 3 Minuten auf ein perfektes (das vielleicht nicht kommt), ist die einfachere Lösung die bessere.

Die Quellenangaben im Dashboard ermöglichen dem Mitarbeiter eine schnelle Kontrolle. Das Zusammenspiel aus Automatisierung und menschlicher Prüfung ist oft effektiver als der Versuch, alles vollautomatisch zu lösen.

2. Kleine Modelle reichen oft aus

Für die Datenextraktion verwende ich GPT-4.1 Nano. Kein großes, teures Modell. Die Aufgabe ist klar definiert: technische Daten aus Text extrahieren und Pflichtattributen zuordnen. Dafür braucht man kein Modell, das kreativ denken oder komplexe Zusammenhänge verstehen kann.

Das spart Kosten und beschleunigt die Verarbeitung. Die laufenden Kosten für den gesamten Stack (Server, APIs, Tools) liegen bei rund 60 bis 70 EUR pro Monat.

3. Den Engpass verschieben, nicht nur lösen

Vorher war der Engpass die Artikelrecherche. Jetzt ist er beim Fotografieren und beim finalen Einstellen in den Shop. Das ist ein gutes Zeichen: Der teuerste Engpass (manuelle Recherche) ist eliminiert. Die verbleibenden Engpässe lassen sich mit weiterer Automatisierung angehen.

Zum Beispiel könnte man die recherchierten Artikel über Nacht in einer Batch-Verarbeitung durchlaufen lassen, sodass morgens bereits alle Daten bereitstehen. Das ist der nächste logische Schritt.

Fazit

Die automatisierte Stammdatenpflege ist einer der wirkungsvollsten KI-Anwendungsfälle für KMU. In diesem Projekt hat ein Investment von unter 5.000 EUR zu einer jährlichen Ersparnis von rund 195.000 EUR geführt.

Die drei wichtigsten Erkenntnisse:

- Nicht jedes Problem braucht einen KI-Agenten. Manchmal ist eine fest definierte Automatisierung schneller, zuverlässiger und günstiger.

- Kleine KI-Modelle reichen für klar definierte Aufgaben. GPT-4.1 Nano bei rund 60 bis 70 EUR laufenden Kosten pro Monat.

- Der ROI ist messbar und schnell. Unter 6 Wochen Umsetzung, Amortisation nach wenigen Tagen.

Haben Sie einen ähnlichen Prozess in Ihrem Unternehmen? Manuelle Recherche, Dateneingabe oder Kategorisierung, die Ihre Mitarbeiter ausbremst? Dann abonnieren Sie meinen Newsletter für praxisnahe Automatisierungs-Tipps. Oder schreiben Sie mir direkt: Ich schaue mir Ihren Prozess an und sage Ihnen ehrlich, ob sich eine Automatisierung lohnt.

Häufig gestellte Fragen (FAQ)

Was kostet eine solche Automatisierung?

Dieses Projekt lag bei unter 5.000 EUR für Konzeption, Entwicklung und zwei Iterationsrunden. Die laufenden Kosten liegen bei rund 60 bis 70 EUR pro Monat für Server, APIs und Tools. Die genauen Kosten hängen vom Umfang und der Komplexität Ihrer Datenquellen ab.

Wie lange dauert die Umsetzung?

In diesem Fall waren es unter 6 Wochen von der ersten Besprechung bis zum produktiven Einsatz. Davon waren 2 Wochen für den ersten Prototyp und 3 Wochen für die Überarbeitung nach dem Kundenfeedback. Einfachere Automatisierungen sind in 1 bis 2 Wochen umsetzbar.

Brauche ich technisches Wissen, um das Tool zu bedienen?

Nein. Das Frontend ist ein einfaches Webformular: Artikelnummer und Hersteller eingeben, auf “Suchen” klicken. Die Ergebnisse erscheinen innerhalb einer Minute. Die Mitarbeiter, die das Tool täglich nutzen, sind Minijobber ohne technische Ausbildung.

Funktioniert das auch mit anderen Produktkategorien?

Ja. Der Ansatz ist übertragbar auf jede Art von Produktrecherche, bei der Sie auf Basis einer Artikelnummer oder eines Produktnamens technische Daten aus dem Internet zusammentragen müssen. Das betrifft neben Maschinenersatzteilen zum Beispiel auch Elektronik, Industriebedarf oder Autozubehör.

Warum kein KI-Agent, sondern eine feste Automatisierung?

KI-Agenten eignen sich hervorragend für Aufgaben, bei denen der Ablauf nicht vorhersehbar ist und das System selbstständig Entscheidungen treffen muss. Bei der Artikelrecherche ist der Ablauf aber immer identisch: Suchen, Scrapen, Kategorisieren, Zusammenfassen. Dafür ist eine feste Automatisierung schneller und zuverlässiger. Mehr dazu lesen Sie in meinem Artikel zu KI-Agenten Grundlagen.

Fabian Stegmaier

KI-Automatisierung & n8n-Experte aus Salzburg. Ich helfe KMU im DACH-Raum bei der Implementierung intelligenter Workflows.

Mehr erfahren →